Wsiąkłem. W pracę. I oczywiście, że coraz intensywniej zacząłem używać AI. Teraz nie wyobrażam sobie pracy bez jakiegoś LLMa.

Czy to dlatego, że jestem leniwy? Z pewnością! Do tego jestem też ciekawy jak to się wszystko potoczy. Niewątpliwie zmiany już są widoczne na rynku pracy - zwolnienia, przetasowania i optymalizacje.

Dzisiaj opiszę Ci jak wygląda praktyczne zarządzanie platformami przy użyciu AI. A jeśli szukasz okazji na Black Friday to info o nich znajdziesz na końcu ⬇️.

Jak wykorzystuję AI do zarządzania platformami

Wszystko zaczyna się od tego, że cała platforma jest w kodzie - wszystko zarządzane przez GitOps. To nie jest opcjonalne, to jest fundament. Bez tego nie ma mowy o sensownym wykorzystaniu AI do zarządzania platformą.

Mój proces podzieliłem na dwa etapy:

Etap 1 - Zarządzanie z czatu w IDE z AI

To jest to, co robię teraz na co dzień. Zamiast ręcznie edytować pliki, uruchamiać komendy i sprawdzać status, po prostu rozmawiam z agentem w IDE.

Kluczowe jest tutaj wykorzystanie MCP (Model Context Protocol) - standardu, który pozwala agentom korzystać z narzędzi i serwisów. Napisałem nawet własny serwer MCP do OCI, bo brakowało takiego rozwiązania.

To pokazuje, jak ważne są te komponenty - bez nich agent nie ma dostępu do rzeczywistych systemów. Więcej o moim projekcie związanym z AI i zarządzaniem platformami możesz przeczytać w tym artykule.

Etap 2 - Agenty działające na platformie

To jest przyszłość, nad którą pracuję. Agenty działające bezpośrednio na platformie (jako pody w klastrze Kubernetes), które odpowiadają za:

- koordynację aktualizacji

- sprawdzanie kodu w repo GitOps (buildy na PR)

- optymalizację kosztową

- automatyczne reagowanie na problemy

To jeszcze nie jest gotowe, ale widzę tu ogromny potencjał.

Jakich narzędzi używam?

Głównie IDE z wbudowanymi agentami AI. Próbowałem różnych:

- Cursor - bardzo spoko, fajne usystematyzowanie rules i instrukcji. To był game-changer dla mnie.

- VS Code z GitHub Copilot - mnie nie przekonał, brakowało mi spójności w podejściu. Efekty były gorsze niż w przypadku Cursora, nawet w wersji płatnej.

- Antigravity - wydany niedawno, za darmo to przewaga, dobry model, ale u mnie się gubił. Jeszcze nad nim popracuję.

- Windsurf, Zed i inne - trochę próbowałem, może wrócę do nich w przyszłości.

Moje wnioski z dotychczasowej pracy

Po kilku miesiącach intensywnego używania AI do zarządzania platformami, mam już sporo obserwacji:

GitOps jest konieczny - to oczywista oczywistość

Bez GitOps nie ma mowy o sensownym wykorzystaniu AI. Agent musi mieć dostęp do kodu, który opisuje stan platformy. Bez tego nie może nic zrobić. To nie jest opcjonalne.

Jeśli chcesz dowiedzieć się więcej o GitOps, zapraszam do poprzednich newsletterów i odcinków podcastu, gdzie szczegółowo o tym opowiadałem.

Context pożera pieniądze jak szalony

Firmy od modeli będą bogate. Moje $20 “wydałem” w niecałe 2 tygodnie!

Trzeba ograniczać spożycie i nauczyć się jak to robić. Duże konteksty wysyłane do modeli LLM są drogie, więc warto:

- ograniczać ilość plików w kontekście

- używać podsumowań zamiast pełnych plików

- wybierać modele z mniejszymi kontekstami, gdy to możliwe

- korzystać z MCP, które może być bardziej efektywne niż wrzucanie wszystkiego do kontekstu

Jeszcze się tego uczę, bo firmom od modeli nie zależy, abym płacił mniej :)

Serwery MCP są krytycznym składnikiem, ale…

Są w powijakach. Standard się rozwija - to super! Każdy chce coś napisać (i kto to mówi 😉).

Przykładem jest serwer MCP do GitLaba - oficjalny jest używany tylko dla wyższych licencji. Ten, którego używałem, miał ostatnio problemy i nie doczekałem się na rozwiązanie.

Zaskoczyło mnie, że wszystkie zmiany w Git szły po MCP - to pokazuje, jak ważne są te serwery. W końcu użyłem innego, ale nie ma wszystkich tooli - np. nie może zrobić merge.

To pokazuje, że ekosystem MCP jest jeszcze młody i potrzebuje czasu na stabilizację, aby można było znaleźć solidne serwery do naszych potrzeb.

Komendy mogą zastąpić MCP!

Czasem agent zamiast użyć narzędzi z MCP wykonuje komendy i daje radę. Jak jest błąd, dobrze zna składnię, pięknie pisze złożone komendy.

Przy izolowanym środowisku z dobrą konfiguracją to… może wystarczyć!

ALE MCP ma być lepsze, szczególnie że ma funkcje pytania o szczegóły (elicitation - niewiele jeszcze implementuje). To pozwoli agentom lepiej zrozumieć dostępne opcje przed wykonaniem akcji.

Agenty z IDE korzystające z web dają radę

Bez tego radziłyby sobie gorzej. Szukają dokumentacji raczej niż specyfikacji - to mnie zaskoczyło.

Czyli dostęp do internetu jest konieczny, aby taka praca była lepsza. Agent musi móc sprawdzić aktualną dokumentację, znaleźć przykłady i zrozumieć najlepsze praktyki.

Krytyczny element - instrukcje

Mam plik AGENTS.md, gdzie opisuję reguły. To jest absolutnie kluczowe!

Nowy flow mojej pracy wygląda tak:

- Proszę agenta o zmianę

- Agent myśli i wprowadza zmianę

- Ja tą zmianę sprawdzam - czy nie zahalucynował, czy nie ma przestarzałej wiedzy, czy da się lepiej

- Proszę o poprawki

- Wprowadzam nową regułę na przyszłość

- Proszę o uaktualnienie pliku AGENTS.md (Jestem tak leniwy, że sam już tego nie tykam 😄)

Gigantyczna różnica - Cursor “łyknął” reguły i zaczął niemalże od początku dobrze, a Antigravity nie respektował i się poddał (tak! napisał na końcu, aby mu pomóc…).

To pokazuje, jak ważne jest, aby agent faktycznie czytał i stosował instrukcje. Te już są po naszej stronie i bez nich praca jest o wiele bardziej czasochłonna.

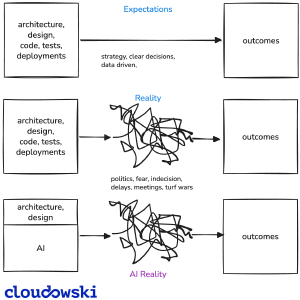

To zdecydowanie force-multiplier

Niestety wciąż czasem muszę poprawiać pracę agenta - złe reguły, rozwiązania z innych wersji, błędy składni itp.

Gdybym nie wiedział jak to może być zrobione (mniej więcej), to agent często by nie dał rady lub błądził wysyłając coraz większy context do LLM.

Często proponuje też zbyt skomplikowane rozwiązania - sam wiem, że da się prościej i łatwiej.

I dlatego to jest doskonały wspomagacz - nie zastępuje wiedzy, ale pozwala działać szybciej i efektywniej. Zamiast godzin spędzonych na żmudnych zadaniach, mogę skupić się na architekturze i decyzjach.

Czy możemy spać spokojnie?

Tak, póki co tak - to jeszcze nie etap, że AI będzie ogarniać platformę samodzielnie. Potrzebuje nadzoru, weryfikacji i kogoś, kto rozumie system.

Nie, jeśli chcesz liczyć się w tej branży - bez wiedzy o tym jak działa Kubernetes, Linux, kontenery, Helm, Git i inne elementy nowoczesnego stacku, AI już zastępuje pozycje juniora, podobnie jak przy programowaniu.

Jeśli nie rozumiesz podstaw, nie możesz weryfikować tego, co robi agent. A weryfikacja jest kluczowa - agent może zrobić coś, co wydaje się poprawne, ale w rzeczywistości jest błędne lub nieoptymalne.

Chcesz wykorzystać AI? Zaczynaj używać już teraz, testuj edytory i modele, nawet jak to się zmienia. To jest moment, kiedy warto wejść i nauczyć się, jak z tym pracować.

Oferta Black Friday

Ja również przygotowałem coś specjalnego na tę okazję, szczególnie dla tych, co chcą się rozwijać.

Specjalna oferta do końca piątku - sprawdź na stronie https://edu.cloudowski.com.

Comments